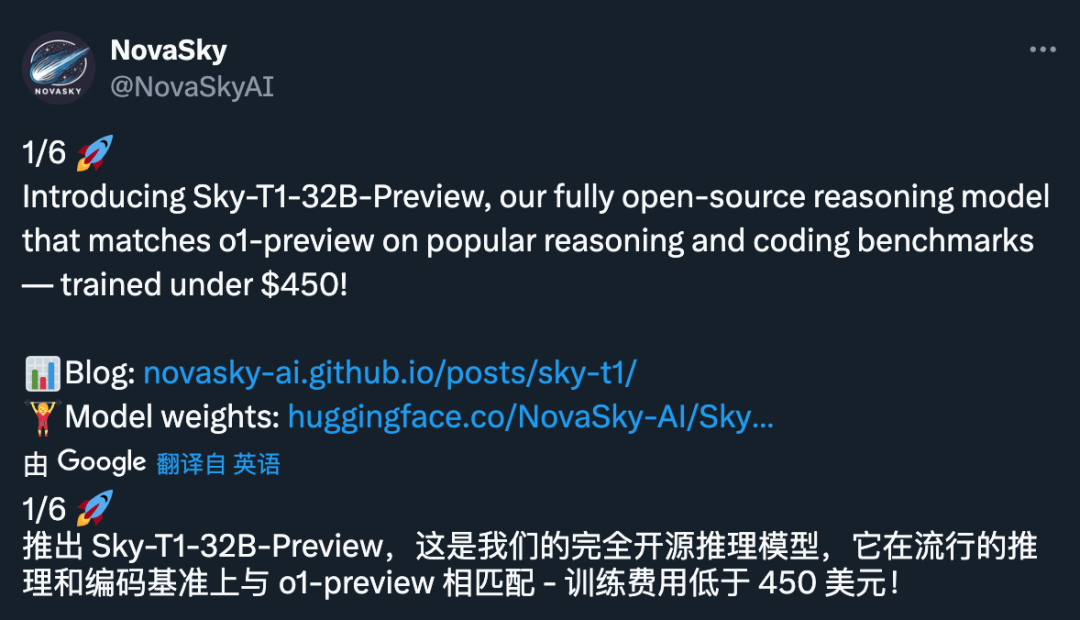

450 美元的价格乍一听不算便宜,但如果这是训练一个拥有 32B 参数的推理模型的成本呢?加州大学伯克利分校的天空计算实验室(NovaSky)最近发布了 Sky-T1-32B-Preview 模型,其训练成本仅为 450 美元。这一成果表明,高级推理能力的开发正变得越来越经济和高效。

开源贡献与技术细节

Sky-T1-32B-Preview 不仅在多个关键基准测试中表现出色,还成为第一个真正开源的推理模型。团队发布了训练数据集、代码和模型权重,任何人都可以轻松复制并改进该模型。这为学术界和开源社区提供了宝贵资源。

成本降低的背后

不久前,训练一个同等性能的模型可能需要数百万美元。通过使用合成训练数据或由其他模型生成的数据,成本大幅降低。例如,AI 公司 Writer 的 Palmyra X 004 几乎完全基于合成数据进行训练,开发成本仅为 70 万美元。

未来展望

随着大模型技术的迅速发展,未来的模型将可以在个人计算机上运行,甚至支持多达 2000 亿个参数。Nvidia Project Digits AI 超级计算机售价 3000 美元,使得高性能计算变得更加普及。

技术实现与优化

为了生成高质量的训练数据,团队使用了 QwQ-32B-Preview 进行数据整理,并采用了拒绝采样程序来提高数据质量。他们还用 GPT-4o-mini 将 QwQ trace 重写为结构规整的版本,以简化解析过程。这些优化措施显著提高了模型在各种任务中的表现。

训练与评估

团队使用 Qwen2.5-32B-Instruct 进行微调,采用 DeepSpeed Zero-3 offload 在 8 个 H100 GPU 上完成训练,总成本约为 450 美元。Sky-T1 在 MATH500 和 LiveCodeBench 等基准测试中表现出色,但在 GPQA-Diamond 上稍逊一筹。

关键发现

模型大小和数据混合对性能有重要影响。较大的模型(如 32B 参数)通常表现更好,而不同领域(如数学和编程)的任务需要不同的推理方法。均衡的数据混合使模型在两个领域都表现出色。

本文来源: 机器之心【阅读原文】

机器之心【阅读原文】