微软Muse模型登上Nature,开启游戏生成新时代

2月20日,微软的首个世界和人类行动模型(WHAM)Muse在国际顶级学术期刊《自然》上发表。Muse是一款基于视频游戏生成的AI模型,拥有高达16亿参数,经过接近7年的人类游戏数据训练。该模型能够理解游戏中的物理环境和3D场景,并生成玩家的动作及视觉效果。尽管目前仅能以300×180像素的分辨率生成游戏画面,但其生成的游戏视频效果已具备一致性、多样性和持久性。

Muse由微软研究员游戏智能团队、可教的AI体验(Teachable AI Experiences)团队与Xbox Games Studios旗下的Ninja Theory合作开发。微软已经开源了权重和样本数据,并提供了一个可视化的交互界面WHAM Demonstrator供开发者使用。此外,Xbox计划在Copilot Labs上试用基于Muse构建的简短交互式AI游戏体验。

基于7年人类游戏数据训练,模型参数达16亿

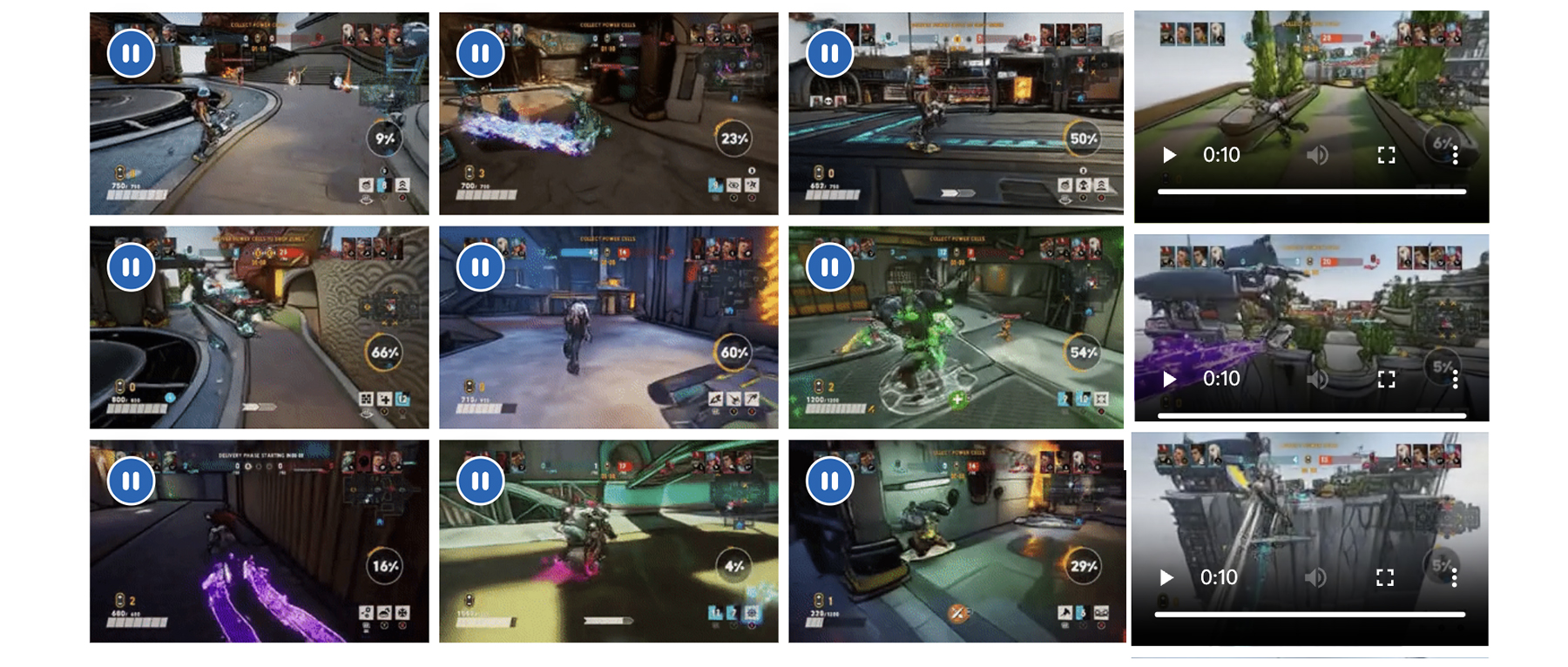

Muse的训练数据来自Xbox游戏Bleeding Edge的7张地图,包含约50万个匿名游戏会话,总数据量达27.89TiB。这些数据相当于7年多的人类游戏时间。研究人员从这些数据中提取了540个Tokens,用于编码每张图像。此外,Muse还可以通过提示模型使用10个初始帧(1秒)的人类游戏和整个游戏序列的控制器动作来生成新的游戏片段。用户可以加载视觉对象作为初始提示,并使用Muse生成多个可能的延续图像,甚至可以通过游戏控制器指导角色动作。

多学科协作评估,确定三大模型能力

研究人员首先总结了27名游戏开发创意人员的用户研究结果,评估了发散思维和迭代实践在使用生成式AI实现新颖性设计中的重要性。他们确定了一组关键的生成模型能力:一致性、多样性和持久性。一致性确保生成的序列随时间推移并与游戏机制保持一致;多样性允许模型产生大量不同的序列,反映不同的潜在结果;持久性使得用户对游戏视觉效果和控制器动作进行修改,并将它们同化到生成的游戏序列中。

Muse基于人类游戏数据进行训练,准确捕捉了游戏环境的3D结构、控制器动作的效果和游戏的时间结构。为了实现这些能力,研究人员使用VQGAN图像编码器将图像编码为Tokens序列,并通过自回归采样生成新的序列。此外,他们还优化了模型在H100 GPU上的大规模训练,提升了图像编码器的分辨率和模型规模。

生成效果接近人类真实水平,新角色也能合理融入

论文展示了Muse在一致性、多样性和持久性方面的具体评估结果。研究人员通过Fréchet视频距离(FVD)衡量一致性效果,发现生成的游戏玩法与真实情况高度匹配。Wasserstein距离用于评估模型动作是否捕捉到人类动作的全部分布,结果显示Muse的生成效果逐渐接近人类玩家的行为。此外,Muse能够保留已插入到看似合理但新的起始位置的常见游戏元素,展示了其强大的持久性。

结语:微软世界模型,开启重塑游戏体验新大门

微软的新世界模型Muse展示了生成式AI在游戏领域的巨大潜力。它不仅学习了游戏世界的丰富结构,还能支持模型的创造性使用,从根本上改变用户未来保存和体验经典游戏的方式。微软已经开源了权重和样本数据,加速了开发者基于此进行后续研究。未来,或许会有更多基于AI的新颖游戏体验诞生,挖掘出AI在游戏应用的更多应用场景。

本文来源: 智东西【阅读原文】

智东西【阅读原文】