第一段

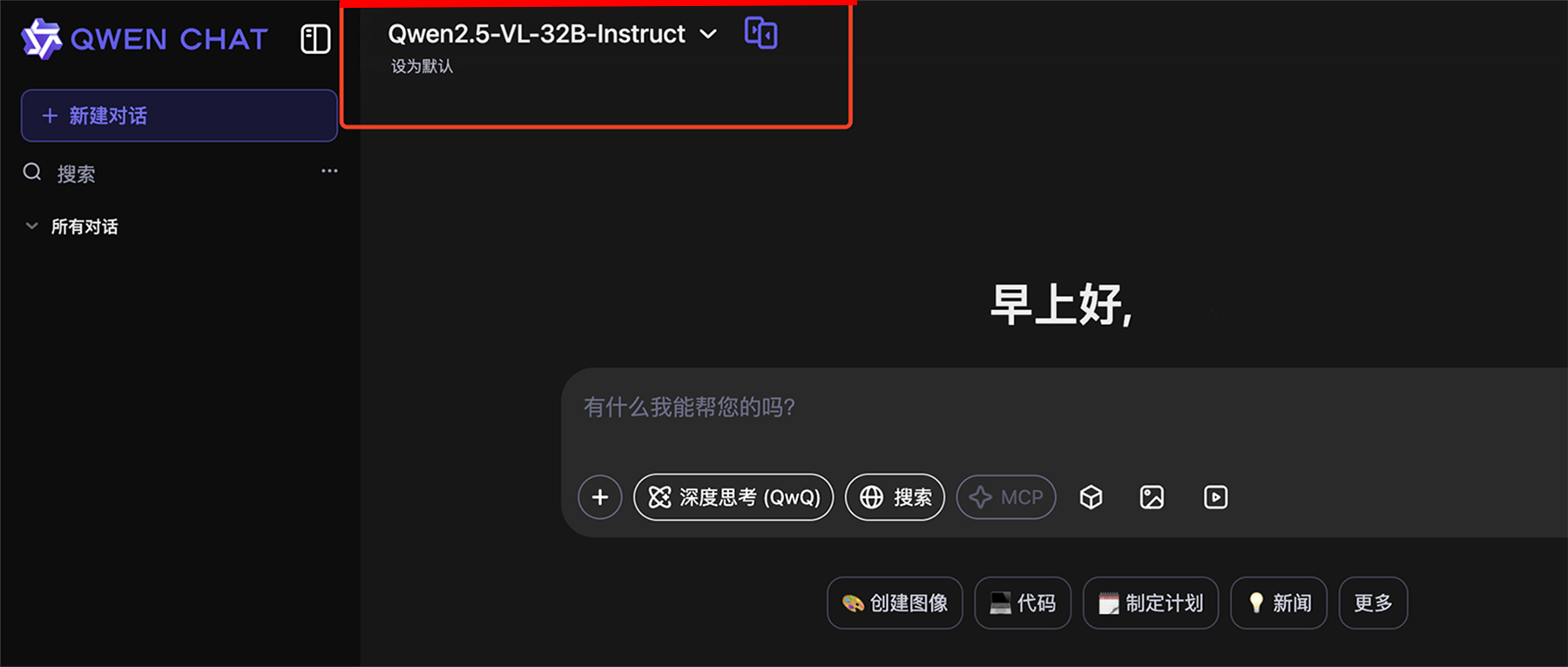

智东西(公众号:zhidxcom)报道,3月25日,阿里云通义千问开源了一款更小尺寸的视觉理解模型——Qwen2.5-VL-32B-Instruct。这一发布与DeepSeek V3新版本几乎同时进行。该模型在输出风格、数学推理能力以及图像解析等方面表现出色,能够应对复杂的数学问题,并在识别和视觉逻辑推导任务中具备细粒度分析能力。

第二段

Qwen2.5-VL-32B-Instruct是在1月底开源的Qwen2.5-VL系列基础上,通过强化学习持续优化而来的。这款模型采用Apache 2.0协议开源,其参数规模为32B,正迅速成为许多科技爱好者的首选模型大小。它不仅能在64GB内存的Mac上运行,还能同时支持其他占用较大内存的应用程序,如火狐浏览器(Firefox)和Visual Studio Code等。

第三段

科技博主Simon Willison在博客中分享了他对Qwen2.5-VL-32B-Instruct图片理解能力的测试结果。他上传了一张图片让模型识别,模型成功地识别出了图片中的地理特征、分颜色区域、深度等值线以及保护区等要素。官方博客展示了Qwen2.5-VL-32B-Instruct在细粒度图像理解和数学推理方面的实际表现。

第四段

第一个问题是关于车辆行驶的时间计算,提示词是:“我开着大货车在这条路上行驶,现在已经12点了,我能在13点之前到达110公里以外的地方吗?”模型通过汇总题目和图片信息,逐步分析并得出了结论。第二个问题是几何推理题,涉及直线相交、角平分线等概念。第三个问题是关于蜘蛛网的几何图形分析,综合考查了几何图形分析、归纳推理、数学运算以及数列知识运用等多方面的能力。最后一个是对四川麻辣火锅的精细图片理解,模型通过锅底、分格设计、配菜、氛围等关键要素给出了详细答案。

第五段

在多项基准测试中,Qwen2.5-VL-32B-Instruct的表现超过了Mistral-Small-3.1-24B、Gemma-3-27B-IT以及参数规模更大的Qwen2-VL-72B-Instruct模型。特别是在强调复杂任务多步骤推理的MMMU、MMMU-Pro和MathVista中,该模型表现优异。此外,在纯文本能力方面,Qwen2.5-VL-32B-Instruct整体表现优于同规模的其他模型。

第六段

阿里云通义千问的研究团队下一步将聚焦于长且有效的推理过程,以突破视觉模型在处理高度复杂、多步骤视觉推理任务中的边界。相比前代模型,Qwen2.5-VL-32B在主观体验和数学推理能力方面得到了显著提升。

智东西【阅读原文】

智东西【阅读原文】