(由多段落组成)

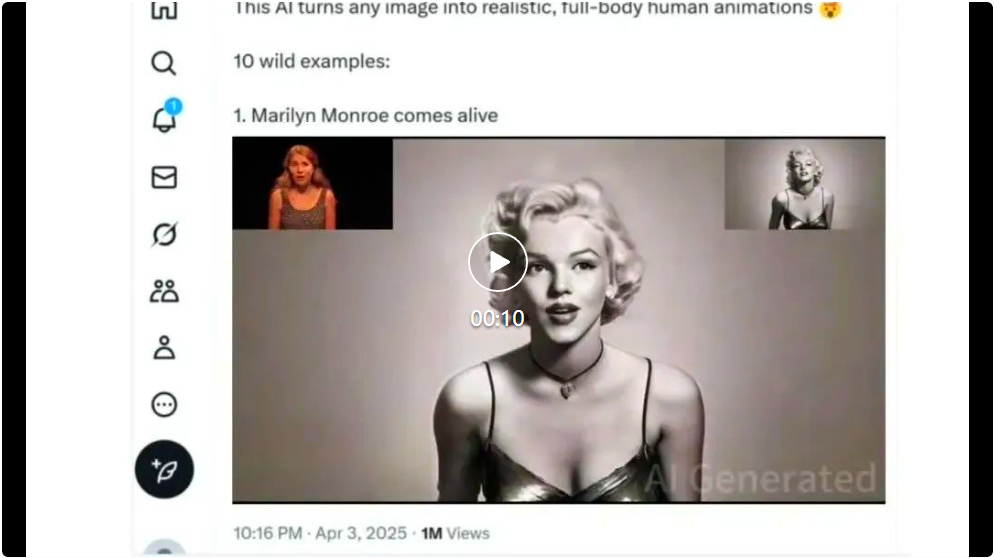

动作捕捉技术迎来了新的革命。当 GPT-4o 的热度席卷全球时,X 平台(前身为推特)上涌现了大量带有视频的热门帖子。其中一段视频吸引了超过一百万的浏览量——玛丽莲·梦露仿佛“复活”了!她不仅能够同步语音和口型,还能完美复刻参考示例中的动作。即使在大幅度的手臂摆动中,也没有出现明显的变形或虚影。网友们纷纷惊叹:“这难道都是 AI 生成的吗?”

这些视频更是将技术推向了新高度。与传统的黑白梦露视频相比,这些视频中的环境光影更具挑战性。仔细观察可以发现,无论是人物的动作还是光影变化都极为自然。例如,灰色衣服男子的衣服在不同动作下会随着身体摆动而产生相应的变化。许多网友感叹,AI 技术的进步或许已经让传统动作捕捉变得不再必要。

本周四,网络上爆火的一系列 AI 视频效果均来自字节跳动提出的新框架 DreamActor-M1。这是一个基于扩散式 Transformer(DiT)的人体动画生成框架,通过混合引导机制实现了对动画的精细化整体控制、多尺度适应以及长时间一致性。只需一张参考图像,DreamActor-M1 就能模仿视频中的人物行为,生成高质量、富有表现力且真实感十足的人体动画,从肖像到全身都能跨尺度呈现。

论文DreamActor-M1: Holistic, Expressive and Robust Human Image Animation with Hybrid Guidance

论文链接:https://arxiv.org/pdf/2504.01724

项目页面:https://grisoon.github.io/DreamActor-M1/

以下是该研究的核心要点总结:

在运动引导方面,研究者设计了一套融合隐式面部特征、3D 头部球体和 3D 身体骨架的混合控制信号,确保面部表情和身体动作的生成既生动又一致。

在尺度适应方面,字节跳动采用了逐步训练策略,利用多分辨率、多比例的数据进行训练,从而提升了模型对不同尺度和姿态的泛化能力。

在外观引导方面,研究者结合连续帧中的运动模式与视觉参考,增强了复杂动作中未显区域的时间一致性。

DreamActor-M1 的总体流程如下:首先,从驱动视频的帧中提取出人体骨架(表示姿势)和头部球体(表示头部位置和朝向)。接着,这些信息被输入到姿态编码器模块,转化为姿态潜变量。同时,研究者还使用 3D VAE 对视频片段进行编码,得到加噪声的视频潜变量。最终,面部表情通过面部动作编码器单独处理,转化为隐式的面部信息。

系统还可以选取输入视频中的一张或多张图像作为参考图像,帮助模型更好地保留人物的外貌细节。在训练过程中,DreamActor-M1 采用共享权重的双分支结构,分别处理噪声 token 和参考 token。通过对比生成的去噪视频潜变量与真实视频潜变量,模型逐步学会还原人物动作。

实际应用中,只需一张人物图片和一段动作视频,就能让图片中的人物动起来。为了保持人物在不同视角下的一致性,参考图可以是一张单图,也可以是模型合成的“伪多视角”。与其他 SOTA 方法相比,DreamActor-M1 在保真性和稳定性方面表现出色,极少出现鬼影或变形现象。

然而,这项技术仍存在一些局限性。例如,在某些案例中,由于视角问题,生成画面中的嘴部动作可能无法完全同步。但随着技术的进一步发展,未来不仅传统动作捕捉可能会被取代,电影中的危险特技也可能找到替代方案。

本文来源: 机器之心【阅读原文】

机器之心【阅读原文】